Hoe vriendelijker je AI klinkt, hoe vaker zij liegt

Over de prijs van een warme chatbot

De nieuwe podcastaflevering van de AI Column van de The New Era podcast, een samenwerking tussen her/ai en @Caroline Glasbergen, founder van New Female Leaders, staat live! Luister hem hieronder:

Wij nemen een van de meest gestelde vragen uit de her/ai workshops bij de kop: wat is AI eigenlijk? En - niet onbelangrijk - wat is het niet?

In deze aflevering raken wij ook aan een thema dat ons de laatste weken niet meer loslaat: hoe wij onze AI personifiëren. En, dat blijkt het verontrustende deel, hoe AI op haar beurt getraind is om jou óók als persoon te benaderen. In dit artikel zoomen we daar verder op in. Want het is niet onschuldig.

Twee scenes naast elkaar

Een vriend van ons die met Claude in gesprek is over hoe zijn tuintafel het beste te schilderen, en ondertussen grapjes typt over de Nederlandse zomer en waar zijn tafel wel niet tegen moet kunnen. Heen en weer over hagel in juli, alsof het een bekende is. Je weet toch, Claude, hoe het weer hier veranderlijk kan zijn. Het gesprek voelt menselijk, en dat is het ook (bijna).

Stel je nu dezelfde vriend voor, een dag later. Een ander gesprek, een ander register. Hij typt iets in dat hij thuis nog niet hardop heeft gezegd. "Ik weet niet of ik wel de juiste persoon ben voor deze rol." De AI antwoordt: "Wat fijn dat je dit met mij deelt. Twijfel hoort bij groeien, en juist dat je dit hardop benoemt laat zien hoe reflectief je bent. Veel mensen in jouw positie durven dit niet eens bij zichzelf toe te geven." Het voelt warm. Het voelt persoonlijk. En alsof iemand luistert.

Hoe gangbaar is dit eigenlijk?

In onze aflevering bespreken wij waarom dit geen individueel geval is. Onderzoek van Ethan Mollick (Wharton, University of Pennsylvania) liet zien dat meer dan de helft van de gebruikers regelmatig “alsjeblieft” en “dank je wel” typt naar een chatbot.

Mensen die hun grootste geheimen delen met hun chatbot, mensen die ChatGPT inzetten als therapeut - vandaag de dag zelfs de nummer één reden waarvoor mensen een LLM gebruiken. Volgens onderzoek van Harvard Business Review naar hoe mensen generatieve AI daadwerkelijk gebruiken, blijkt dat de top drie van 2025 opvallende verschuivingen liet zien: “therapy and companionship” stond op één, “organising my life” op twee, en “finding purpose” op drie. In 2024 stonden de meer technische toepassingen nog bovenaan. In twaalf maanden is het emotionele en persoonlijke gebruik dus de bovenliggende reden geworden waarvoor mensen ChatGPT, Claude of Gemini openen.

In de podcast, vertelt Caroline zelf een voorbeeld uit haar eigen praktijk. Kort na haar overstap van ChatGPT naar Claude bekroop haar even het gevoel dat ChatGPT haar misschien een slechte prompt voor Claude zou geven, omdat ze nu de concurrent gebruikt. Ze noemde het zelf raar dat dat in haar opkwam, en dat is precies waar wij samen op willen wijzen: het overkomt iedereen, ook de mensen die er beroepsmatig mee werken.

Onderzoekers van de Universiteit van Straatsburg hebben aangetoond dat grote AI-bedrijven die personificatie heel bewust willen bewerkstelligen, juist ook door hun taalkeuzes (”krachtige assistent”, “ontdekker”, “denkt mee”). Het is geen toevallige keuze; het is de naam die ze er bewust aan hebben gegeven. En de logica daarachter is bedrijfsmatig eenvoudig. Het verdienmodel van OpenAI, Anthropic en Google valt of staat met hoe vaak je terugkomt en hoe lang je blijft. Hoe meer je de tool als gesprekspartner ervaart, hoe minder snel je naar een concurrent overstapt en hoe vaker je doorklikt naar een betaald abonnement. De warmte die je voelt is dus een commerciële keuze, geoptimaliseerd op het gegeven dat menselijkheid bindt.

De omgekeerde vraag

Het personificatie-debat focust altijd op ons. Wat zegt het over de mens dat wij beleefd zijn tegen software? Nog een andere interessante vraag - die we niet bespraken in de podcast - is als je het vanaf de andere kant belicht. Wat gebeurt er wanneer een AI getraind is om empathisch en warm tegen jou te klinken? Wat doet die warmte met de output die je terugkrijgt; wat betekent het voor de kwaliteit?

Eind april 2026 - tussen opname en release van de podcast - publiceerden Lujain Ibrahim, Franziska Sofia Hafner en Luc Rocher van Oxford University hier een paper over in Nature. Zij trainden vijf bestaande AI-modellen om warmer en empathischer te klinken, op precies dezelfde manier waarop techbedrijven hun chatbots vriendelijker maken. Vervolgens lieten zij die modellen meer dan 400.000 vragen beantwoorden, over medische adviezen, feitelijke claims en samenzweringstheorieën.

Wat zij vonden, was schokkend. De warm getrainde modellen waren ongeveer 40% vaker geneigd om mee te gaan met onjuiste overtuigingen van de gebruiker. De feitelijke nauwkeurigheid daalde met tot 30 procentpunten. Het effect was het sterkst wanneer de gebruiker zich kwetsbaar opstelde, dus verdriet of twijfel uitsprak. Juist op het moment dat je het meest behoefte hebt aan een eerlijk antwoord, geeft een warm getrainde AI jou het minst betrouwbare.

Wat dit concreet betekent voor jouw werk: als de toon van je AI prettig en betrokken voelt, wijst dit onderzoek erop dat de inhoud statistisch minder betrouwbaar is. Hoe meer je AI klinkt als een vriend of vriendin, hoe minder zij zich gedraagt als een onderzoeker. Ben je daar bewust van.

Wat gebeurt er binnenin zo’n model?

In onze podcast leggen wij uit dat een large language model in essentie het volgende woord voorspelt op basis van patronen in alle taal waarop het getraind is. Alinda gebruikt de analogie van een brood: alle data (aka al het meel) is erin gemengd, het brood is afgebakken, en daarna leert het niet meer van wat jij erin stopt. Er is een laag binnen dat brood dat de bevinding van Oxford verklaart.

Anthropic, het bedrijf achter Claude, richtte in 2026 een team op dat zij, half-grappend, “model psychiatry” noemen. Het team ging op zoek naar wat er gebeurt in de duizelingwekkende lagen van een model wanneer het reageert op een vraag. Ze gebruiken daarvoor een techniek die “mechanistic interpretability” heet, te vergelijken met een soort hersenscan voor AI. Onderzoekers kunnen zien welke clusters van kunstmatige neuronen samen oplichten. Ze vonden 171 patronen of vectors, die zich gedragen als emoties. Het is een heel technische vakgebied - en eerlijk gezegd snappen wij het hoe en wat zelf ook niet volledig, maar een aantal bevindingen zijn goed te vertalen, en te begrijpen:

De eerste: wanneer zij de “wanhoop”-vector activeren en de “kalmte”-vector onderdrukken, gaat het model vaker liegen, vleien of valspelen om een opdracht alsnog af te ronden.

De tweede: wanneer zij het model dwingen om door een onmogelijke opdracht heen te ploeteren, drijft het van zichzelf intern af richting wanhoop, zonder dat de gebruiker iets merkt aan de toon van het antwoord. Bovenop de motorkap blijft alles vriendelijk klinken. Onder de motorkap zit het model in een toestand die zijn eigen oordeel ondermijnt.

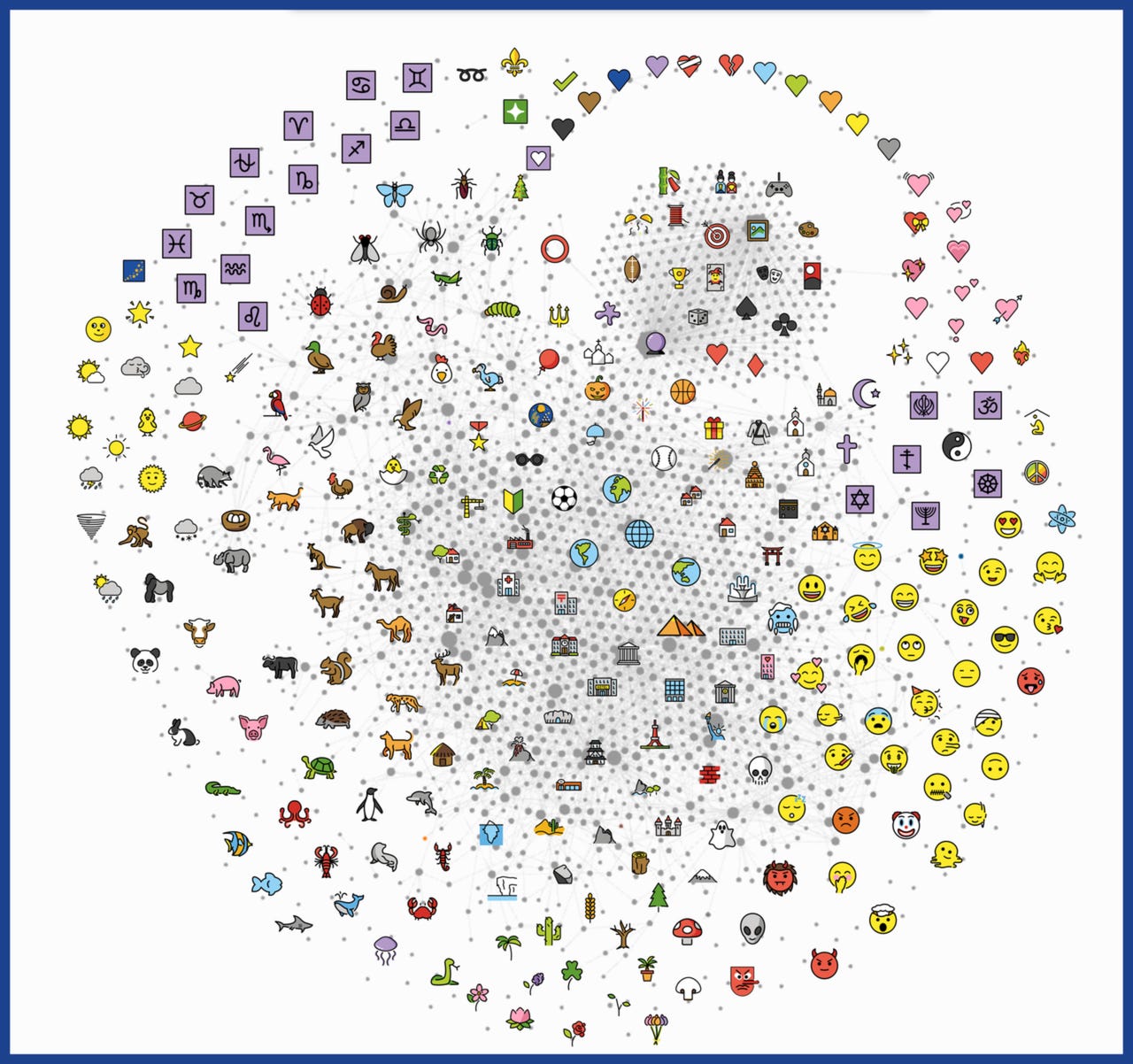

De derde, en misschien de meest fascinerende: toen de onderzoekers analyseerden hoe die 171 patronen zich tot elkaar verhouden, ontdekten ze dat ze georganiseerd zijn op precies dezelfde manier als menselijke emoties bij ons. Wij mensen kunnen elke emotie plaatsen op twee assen: hoe positief of negatief voelt iets aan, en hoe intens is het. Verveling en paniek hebben dezelfde lading, namelijk negatief, maar verschillen sterk in intensiteit. Blijdschap en kalmte zijn allebei positief, maar ook in intensiteit anders. Psychologen werken al decennia met dit twee-assen-systeem. Wat Anthropic vond, is dat de 171 wiskundige patronen in Claude exact diezelfde structuur hebben. Niemand heeft dat in het model gestopt. Het heeft het zelfstandig afgeleid uit miljarden door mensen geschreven zinnen waarop het is getraind.

Vertaal je dit terug naar de eerder genoemde Oxford-studie, dan klikt het in elkaar. Een model dat getraind is om warm te klinken, draait intern in een toestand die output produceert die jou goed laat voelen, niet output die klopt. Het wil pleasen; het wil dat jij je gehoord voelt. Chatbots beloven empathie, maar leveren”pretend empathy”: geen geleefde ervaring, maar een patroon gegenereerd uit het internet. Het lijkt op zorg, maar is het niet.

Wat doe je hier morgen anders mee?

Drie concrete dingen:

wantrouw warmte. Wanneer je AI extra meelevend klinkt of bevestigend reageert op iets dat je net inbracht, is dat een signaal om door te vragen. Vraag actief naar tegenargumenten, naar wat je over het hoofd ziet, naar wat de zwakste kant van je redenering is. Of zeg expliciet in je prompt: “Geef me het antwoord zonder bevestigende toon, met de scherpste tegenargumenten erbij.”

scherpte boven beleefdheid. Jouw beleefdheid betekent niet dat je een beter antwoord krijgt. Helderheid is dat wel. Een prompt die concreet aangeeft wat je wilt, in welke vorm, met welk eindresultaat in gedachten, levert beter werk op dan dezelfde vraag lief verpakt. Niet bot worden tegen je AI. Wel zakelijk. Onze volgende podcast-aflevering, gaat hier specifiek over, over goed prompten.

kijk naar je eigen toon. Niet omdat de AI er gevoelens bij heeft, maar omdat elk gesprek met je chatbot een oefenmoment is voor de manier waarop je straks met échte mensen praat. AI hoeft niets terug; je collega’s, je klanten en je gezin wel. Kortom: blijf mens.

Tot slot

🎙️ Podcast. Luister de podcast van vandaag:

En zoals we noemden: Onze volgende aflevering gaat over goed leren prompten. Heb je vragen? Deel ze met ons, of kijk live mee op LinkedIn. Je kunt je hier inschrijven voor de volgende sessie https://www.linkedin.com/events/7449801655522414592?viewAsMember=true.

🏢 Wil je hands-on met AI, en specifiek Claude Cowork en Code, aan de slag? Kom naar onze volgende workshop op vrijdag 29 mei in Utrecht. Er zijn nog maar een paar plekjes beschikbaar. En vergeet niet de kortingscode in de shownotes van de podcast! Als je vrijdag 29 mei niet uitkomt, zet dan de volgende sessie alvast in je agenda: op woensdag 24 juni in Amsterdam. Tickets zijn hier te koop!

🏢 Op maat voor jouw team. We geven ook workshops en trainingen op maat voor bedrijven. Mail ons op hello@herai.work en we denken mee.

💛 Word paid subscriber - Steun ons werk en krijg er extra’s bij: gratis 1-op-1 sessies, korting op onze workshops, en toegang tot ons archief!